EKS Hybrid Nodes

이제는 Amazon EKS를 온프레미스에서도

Junseok Oh

Sr. Solutions Architect

Amazon Web Services

Agenda

총 40분 세션

온프레미스 Kubernetes 운영의 현실

Control Plane 관리 부담

"버전 업그레이드, etcd 백업/복구, 인증서 갱신... 운영팀의 야근이 끊이지 않습니다"

보안 패치 & 컴플라이언스

"CVE 대응, CIS 벤치마크 준수, 감사 대응에 수개월이 소요됩니다"

모니터링 사일로

"온프렘과 클라우드 환경 간 통합 관측이 어렵습니다"

최신 AI 서비스 접근의 한계

"온프렘 단독 환경에서 최신 AI 모델 활용과 Agent 개발이 어렵습니다"

EKS Hybrid/Edge 포트폴리오

EKS Anywhere

완전한 온프레미스 Kubernetes 배포

- Control Plane + Worker 모두 온프레미스

- VMware vSphere, Bare Metal, CloudStack 지원

- AWS와 독립적으로 실행 가능 (Air-gapped 환경)

- EKS Connector로 콘솔 통합 관리 가능

EKS Hybrid Nodes

Control Plane은 AWS, Worker는 온프레미스

- AWS 관리형 Control Plane + 고객 관리 Worker

- VPN 또는 Direct Connect 연결 필수

- AWS 서비스 (Bedrock, SageMaker 등) 즉시 연계 가능

- 온프렘 GPU/특수 하드웨어 활용 + 클라우드 관리 편의성

EKS on Outposts

AWS 하드웨어를 고객 데이터센터에 설치

- AWS가 하드웨어까지 관리 (완전 관리형)

- 로컬 Kubernetes + AWS 서비스 일체형

- 최소 지연 시간, 데이터 지역성 보장

- 초기 투자 비용 및 공간 요구사항 있음

EKS Hybrid Nodes란?

EKS Control Plane(AWS 완전 관리) + Worker Node(온프레미스) 하이브리드 구성

적합한 사용 사례

- 온프레미스 GPU/특수 하드웨어 활용

- 규제 준수를 위한 데이터 지역성 요구

- 지연 시간에 민감한 Edge 워크로드

- 클라우드 마이그레이션 전환기

부적합한 사용 사례

- 순수 클라우드 네이티브 워크로드 → EKS managed node group 또는 Fargate 권장

- 온프레미스 인프라가 없는 환경

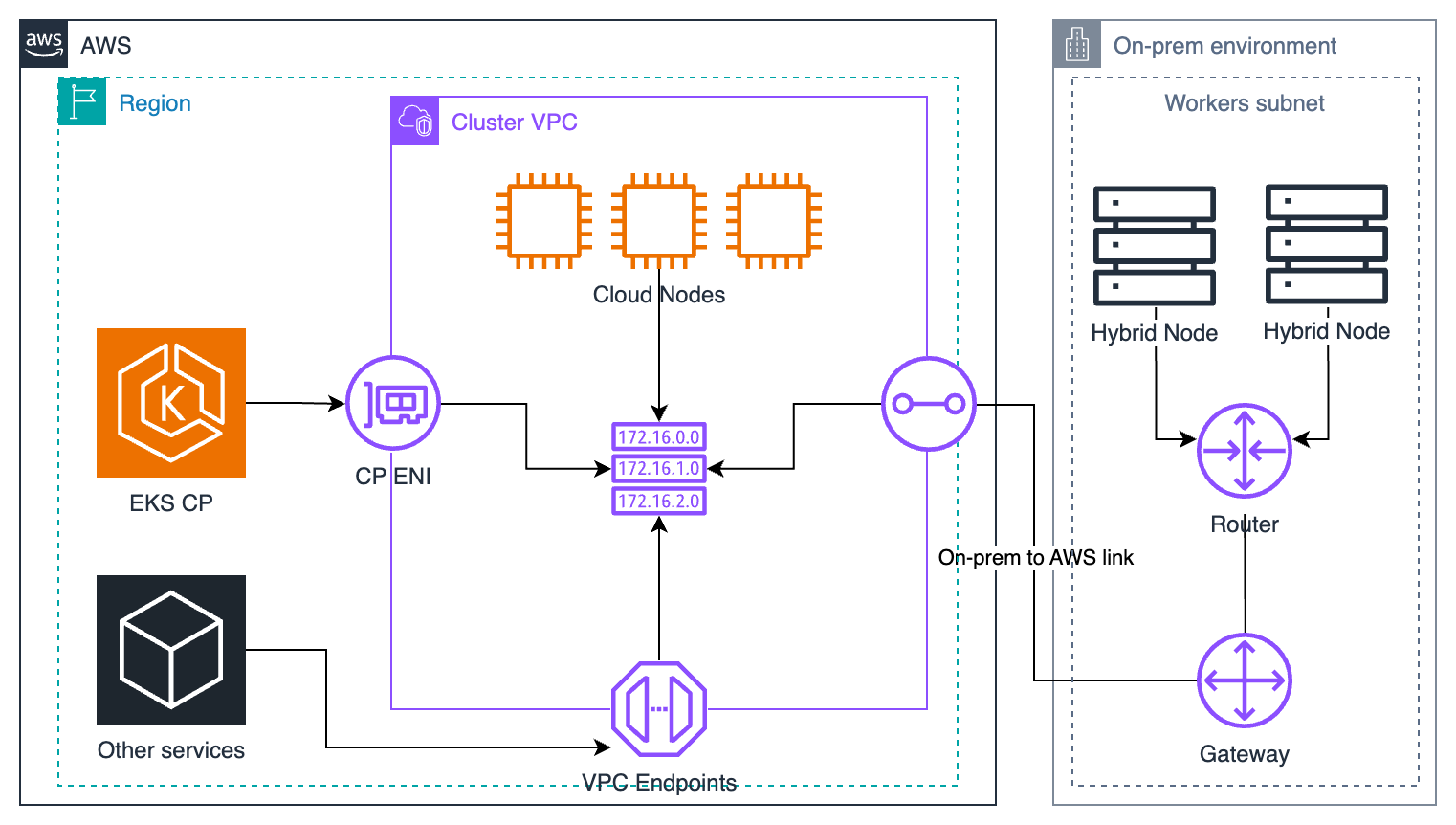

아키텍처 개요: 노드 등록 흐름

IaaS를 넘어서는 가치

Hybrid Nodes = AWS Managed Services Gateway

AI/ML

Bedrock, SageMaker

Database

RDS, ElastiCache

Analytics

OpenSearch, Kinesis

책임 공유 모델

AWS AWS 관리 영역

- EKS Control Plane 가용성

- etcd 백업 및 복구

- API Server 고가용성

- Kubernetes 버전 업그레이드

- Control Plane 보안 패치

Customer 고객 관리 영역

- Worker 노드 (HW, OS, 런타임)

- 온프레미스 네트워크 연결

- CNI 구성 (Cilium/Calico)

- 모니터링 에이전트 배포

- 워크로드 배포 및 관리

주요 제약 사항

도입 전 반드시 확인해야 할 사항

지원 환경

| 항목 | 지원 사양 |

|---|---|

| 운영 체제 | Ubuntu 20.04/22.04/24.04 RHEL 8/9 Amazon Linux 2023 Bottlerocket (VMware) |

| 아키텍처 | x86_64 arm64 (ARMv8.2+) |

| EKS 버전 | 1.31+ |

| 리전 | 대부분의 AWS 상용 리전 지원 |

| CNI | Cilium (공식 지원) Calico (공식 미지원) |

| Container Runtime | containerd 1.6+ |

| 최소 하드웨어 | CPU 1 vCPU Memory 1 GiB Disk 50 GB 권장: 4코어 / 8GB / 100GB NVMe |

크리덴셜 프로바이더

노드 인증 방식 선택

SSM Hybrid Activations

- PKI 인프라 불필요 - 빠른 설정

- Activation Code + ID로 간편 등록

- 자동 자격 증명 갱신

- 세션 지속 시간: 최대 1시간

IAM Roles Anywhere

- 기존 PKI 인프라 활용 가능

- X.509 인증서 기반 인증

- 세션 지속 시간: 최대 12시간

- 에어갭(Air-gapped) 환경에 적합

Block 1 Quiz

학습 내용을 확인해 봅시다

Q1. EKS Hybrid Nodes에 적합하지 않은 사용 사례는?

Q2. EKS Hybrid Nodes가 지원하는 운영 체제 조합은?

Q3. EKS Hybrid Nodes의 최소 하드웨어 요구 사항(AWS 공식)은?

Q&A

EKS CP는 AWS 관리형

온프렘 인프라 활용

VPN/DX로 안전한

하이브리드 네트워킹

nodeadm으로 간편한

노드 부트스트랩

SSM 또는 IAM RA

인증 프로바이더

궁금한 점이 있으시면 질문해 주세요

네트워킹 심층분석

CIDR 설계, 6가지 트래픽 패턴, 방화벽 규칙

네트워크 전제 조건

EKS Hybrid Nodes를 위한 네트워크 아키텍처 요구사항

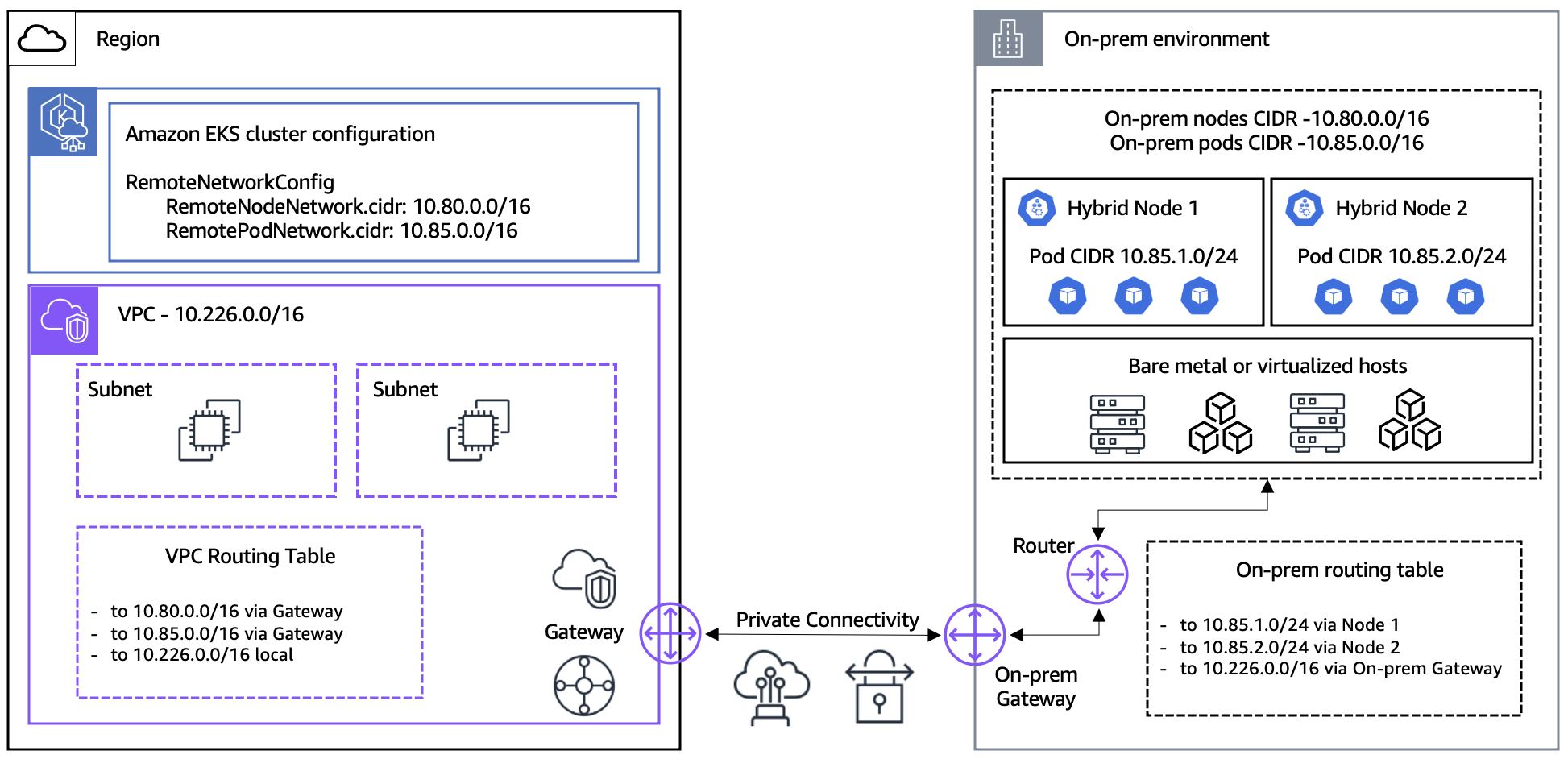

CIDR 설계 체크리스트

IP 충돌 없는 하이브리드 네트워크 설계

- Remote Node CIDR: 온프렘 노드 IP 범위 (예: 10.80.0.0/16)

- Remote Pod CIDR: 온프렘 파드 IP 범위 (예: 10.85.0.0/16)

- VPC CIDR과 겹치지 않을 것

- Service CIDR과 겹치지 않을 것

- RFC-1918 범위 내에 있을 것 (10.x, 172.16-31.x, 192.168.x)

- 최대 15개 CIDR 블록 제한 준수

Pattern 1: Kubelet → EKS Control Plane

Kubelet이 API 서버에 연결하는 경로

aws eks update-cluster-config --name <cluster> --resources-vpc-config endpointPrivateAccess=truePattern 2: Control Plane → Kubelet

API Server가 Kubelet에 연결 (port 10250)

# 방화벽에서 TCP 10250 허용 필요Pattern 3: Pod → EKS Control Plane

Pod가 CoreDNS를 경유하여 API Server에 접근

cilium status --verbose # NAT 정책 확인Pattern 4: Control Plane → Pod (Webhooks)

Admission Webhook 호출 — Routable Pod CIDR 필수

Pattern 5: Pod ↔ Pod (Hybrid Nodes 간)

VXLAN 캡슐화를 통한 노드 간 Pod 통신

# UDP 8472 양방향 허용: iptables -A INPUT -p udp --dport 8472 -j ACCEPTPattern 6: Cloud Pod ↔ Hybrid Pod

EC2 Pod와 Hybrid Node Pod 간 Cross-boundary 통신

aws ec2 create-route --route-table-id rtb-xxx --destination 10.85.0.0/16 --transit-gateway-id tgw-xxx방화벽 규칙 요약

네트워크 팀과 사전 조율이 필요한 포트 목록

| 포트 | 프로토콜 | 방향 | 용도 |

|---|---|---|---|

| 443 | TCP | On-Prem → AWS | Kubelet → API Server 통신 |

| 10250 | TCP | AWS → On-Prem | API Server → Kubelet (exec, logs, webhooks) |

| 8472 | UDP | 양방향 | Cilium VXLAN 터널링 |

| 4240 | TCP | 양방향 | Cilium Health Check |

| 53 | TCP UDP | 양방향 | CoreDNS 쿼리 |

VPC 엔드포인트 구성

Private Link를 통한 AWS 서비스 접근

필수 Required Endpoints

eks.<region>

api.ecr.<region>

<acct>.dkr.ecr.<region>

Gateway Endpoint

sts.<region>

선택 Optional Endpoints

ssm.<region>

logs.<region>

ec2.<region>

Block 2 Quiz

네트워킹 핵심 개념 점검

Q1. 온프레미스와 AWS 간 네트워크 연결 권장 방법은?

Q2. Kubelet → API Server 통신에 필수인 방화벽 포트는?

Q3. Pod CIDR 설계 시 고려사항이 아닌 것은?

Q4. EKS Hybrid Nodes 권장 네트워크 지연시간은?

Q&A

CIDR 겹침 방지

사전 설계 필수

6가지 트래픽 패턴

이해 & 방화벽 설정

Private Endpoint

권장 (보안 강화)

VPC 엔드포인트

에어갭 환경 핵심

궁금한 점이 있으시면 질문해 주세요

Deep Dive & References

더 깊이 공부하기 위한 공식 문서와 리소스

공식 문서

docs.aws.amazon.com/eks/latest/userguide/hybrid-nodes-networking.html

docs.aws.amazon.com/eks/latest/userguide/private-clusters.html

docs.aws.amazon.com/eks/latest/userguide/hybrid-nodes-networking.html#hybrid-nodes-firewall

추가 리소스

docs.cilium.io/en/stable/network/concepts/routing/#encapsulation

aws.amazon.com/blogs/containers/getting-started-with-eks-hybrid-nodes/

catalog.workshops.aws/workshops/eks-hybrid-nodes

노드 구성 & 운영

nodeadm CLI, Bootstrap, Cilium CNI, 업그레이드

nodeadm CLI

Hybrid Node 부트스트랩을 위한 핵심 도구

- install - kubelet, containerd 등 의존성 설치

- init - 클러스터에 노드 등록

- upgrade - Kubernetes 버전 업그레이드

- debug - 문제 진단 정보 수집

- ssm - Systems Manager Hybrid Activations

- iam-ra - IAM Roles Anywhere

Bootstrap 워크플로우

온프레미스 노드가 EKS 클러스터에 조인되는 8단계

NodeConfig YAML

노드 설정의 핵심 - 4가지 주요 섹션

cluster 섹션 설명

- name - EKS 클러스터 이름

- region - AWS 리전

- apiServerEndpoint - EKS API 서버 엔드포인트 자동 조회

- certificateAuthority - 클러스터 CA 인증서 자동 조회

- cidr - Kubernetes Service CIDR 자동 조회

aws eks describe-cluster 명령으로 필요한 정보를 조회할 수 있습니다.

hybrid 섹션 설명

- ssm - Systems Manager Hybrid Activation 사용

- activationCode/Id - SSM 콘솔에서 생성

kubelet 섹션 설명

- maxPods - 노드당 최대 Pod 수

- shutdownGracePeriod - 정상 종료 대기 시간

- node-labels - Hybrid Node 식별 레이블

- taints -

NoScheduleeffect로 Toleration 없는 Pod 스케줄링 차단 → Hybrid Node 전용 워크로드 격리

containerd 섹션 설명

- config - containerd 설정 파일 내용

- Private Registry mirror 설정 가능

- 에어갭 환경에서 ECR 미러링에 활용

/etc/containerd/certs.d 경로에 레지스트리별 설정을 추가합니다.

CNI 선택 가이드

왜 Cilium인가?

- eBPF 기반 데이터 플레인 — iptables 불필요

- AWS ECR Public에서 공식 빌드 제공

- VXLAN 오버레이 내장 — 온프렘 네트워크 호환

- Hubble로 네트워크 observability 내장

- BGP, Ingress, LB IPAM, kube-proxy replacement 지원

- 지원 버전:

v1.17.x,v1.18.x

- iptables 기반 데이터 플레인

- AWS 공식 문서에서 제거됨 (examples repo에 설정 존재)

- 별도 IP pool 관리 필요

- AWS 기술 지원 범위 밖 (커뮤니티 지원)

Cilium CNI 설치

AWS ECR Public 공식 빌드 + Helm 배포

- OCI Registry — ECR Public에서 공식 빌드 직접 설치

- values YAML — 설정을 파일로 분리하여 GitOps 관리

- namespace — 반드시

kube-system에 설치 - nodeAffinity — Hybrid Nodes에만 배포 제한

Cilium Values & Pod CIDR

cilium-values.yaml 핵심 설정과 Pod CIDR 설계

- VPC CIDR과 겹치지 않도록 설정

- 온프레미스 네트워크와 분리

- 예:

10.85.0.0/16 - /25: 노드당 126 Pod, /24: 254 Pod

- Pod CIDR → 노드 IP 라우팅 필수 (Static 또는 BGP)

노드 등록 확인

kubectl 명령으로 Hybrid Node 상태 확인

업그레이드 전략

안전한 Kubernetes 버전 업그레이드

Rolling Upgrade

노드를 하나씩 순차적으로 업그레이드

Canary Upgrade

1개 노드만 먼저 업그레이드 후 검증

- 새 버전 노드 1개만 업그레이드

- 24시간 모니터링 후 검증

- 문제없으면 나머지 순차 진행

- 프로덕션 환경에 적합

Rollback

업그레이드 실패 시 복구 절차

에어갭 환경

인터넷 연결 없이 Hybrid Nodes 운영하기

Step 1 사전 준비 (인터넷 호스트)

- hybrid-assets.eks.amazonaws.com에서 아티팩트 다운로드

- nodeadm, kubelet, containerd 바이너리

- Cilium 컨테이너 이미지 + S3 업로드

Step 2 런타임 (에어갭 환경)

- Route 53 PHZ — hybrid-assets DNS override

- S3 VPC Endpoint — Private S3 접근

- ECR VPC Endpoint — 컨테이너 이미지 풀

트러블슈팅

자주 발생하는 문제와 해결 방법

증상: kubectl get nodes에서 NotReady

원인: CNI 미설치, kubelet 설정 오류, 네트워크 연결 실패

해결:

- Cilium DaemonSet이 Running 상태인가?

- kubelet이 API Server에 연결 가능한가?

- CA 인증서가 올바르게 설정되었나?

- 방화벽에서 443, 10250 포트가 열려있나?

증상: ImagePullBackOff

원인: ECR 접근 불가, VPC Endpoint 미설정, 크리덴셜 만료

해결:

- ECR VPC Endpoint가 설정되어 있나?

- SSM/IAM RA 크리덴셜이 유효한가?

- Security Group에서 443 포트가 열려있나?

- Private Registry mirror가 설정되어 있나?

증상: DNS 해석 실패

원인: CoreDNS 미배포, clusterDNS 설정 오류, 방화벽 53 포트 차단

해결:

- CoreDNS Pod가 Running 상태인가?

- clusterDNS IP가 올바르게 설정되었나?

- UDP/TCP 53 포트가 허용되어 있나?

- Service CIDR 라우팅이 설정되었나?

- CoreDNS가 Hybrid Nodes에도 스케줄링되어 있나?

Block 3 퀴즈

학습 내용 확인

Deep Dive & References

더 깊이 공부하기 위한 공식 문서와 리소스

공식 문서

docs.aws.amazon.com/eks/latest/userguide/hybrid-nodes-nodeadm.html

docs.aws.amazon.com/eks/latest/userguide/hybrid-nodes-nodeadm.html#hybrid-nodes-nodeconfig

docs.aws.amazon.com/eks/latest/userguide/hybrid-nodes-creds.html

추가 리소스

docs.cilium.io/en/stable/installation/k8s-install-helm/

docs.aws.amazon.com/eks/latest/userguide/hybrid-nodes-artifacts.html

docs.aws.amazon.com/eks/latest/userguide/hybrid-nodes-troubleshooting.html

고급 패턴 & 전략적 가치

Cloud Bursting, 규제 대응, AI Agent, 비용 최적화

Taint/Toleration으로 워크로드 격리

하이브리드 노드에 특정 Pod만 스케줄링

둘 다 설정해야 완전한 워크로드 격리

스케줄링 결과

Hybrid Node 1

Hybrid Node 2

Cloud Node 1

Cloud Node 2

Cloud Bursting with Karpenter

온프레미스 용량 초과 시 클라우드로 자동 확장

Pod Deletion Cost 전략

스케일다운 시 클라우드 Pod 우선 제거

온프렘 Pod

높은 우선순위

마지막에 제거

클라우드 Pod

낮은 우선순위

먼저 제거

적용 방법

- MutatingWebhook으로 노드 레이블 기반 자동 주입

- 또는 Kyverno/OPA 정책으로 구현

MutatingAdmissionWebhook 자동 주입

Pod Deletion Cost · Tolerations 자동 설정

hybrid-inject: "enabled" 레이블이 있는 네임스페이스에만 자동 주입됩니다. 시스템 네임스페이스(kube-system 등)에는 적용하지 마세요.

규제 대응 & 컴플라이언스

데이터 주권 보장과 감사 추적

데이터 위치 선택권

데이터 위치를 자유롭게 선택 — 클라우드도 규제 충족 가능하지만, 온프레미스 유지가 필요한 조직에 최적

감사 추적

IAM Roles Anywhere의 x509Subject/CN으로 노드별 감사 추적 가능 → 인증서 기반 식별

네트워크 격리

VPN/Direct Connect + Private Endpoint로 퍼블릭 인터넷 경유 없음 → 보안 경계 유지

컴플라이언스 자동화

AWS Config, CloudTrail로 Control Plane 관련 컴플라이언스 자동 모니터링

가이드라인 충족

데이터 위치 선택권

유연한 배치 선택

AWS Managed Services 연계

온프레미스에서 AWS AI/ML 서비스 직접 활용

비용 최적화 전략

기존 인프라 활용 + 필요 시 클라우드 확장

(기존 EKS 클러스터 비용 외)

GPU 투자 보존

HA, etcd 백업, 인증서 갱신 포함

유휴 비용 최소화

왜 EKS Hybrid Nodes인가?

Tanzu(VKS) · OpenShift 대비 전략적 장점

레이턴시 26%↓

자동 대응

60% 절감

전환

TensorRT-LLM

핵심 요약

EKS CP는 AWS가 관리

온프렘 인프라 활용

VPN/DX로 안전한

하이브리드 네트워킹

nodeadm으로 간편한

노드 부트스트랩

Bedrock/AgentCore 등

AWS AI 서비스 즉시 연동

데이터 주권 유지 +

관리형 서비스 활용

Q&A

궁금한 점이 있으시면 질문해 주세요